(陆军装甲兵学院士官学校,吉林长春,130031)

摘要:目标检测是机器视觉领域和计算机视觉领域的一项重要课题,其在人脸识别和视频目标识别以及无人导航领域扮演着重要的作用,目标识别的算法多种多样,传统的目标检测算法有很多,比如基于尺度不变性特征和基于方向梯度直方图特征的算法,随着近些年大数据和计算机技术的发展,深度学习算法在众多算法中脱颖而出,目前最为先进且识别率较为准确的算法正是基于深度神经网络的目标检测手段,本文按照时间发展的先后顺序依次介绍了LeNet-5模型、AlexNet模型以及VGG模型,并对未来深度神经网络模型的发展方向从数据集和计算机性能角度进行进一步研究。

关键字:目标检测;深度神经网络;算法

1 引言

目标检测,有时也可以称之为对目标中特征的提取,它是利用目标的特征通过一定的技术手段将其从图片背景中分离出来的。它的应用非常的广泛,包括无人驾驶,导航以及路径规划领域等。随着生活中人们对视觉检测技术的要求不断提高,传统的目标检测算法已经无法满足要求,随着计算机运算能力和大数据处理技术的不断发展,以深度神经网络为代表的一些智能算法逐渐崭露头角,其识别精度和识别准确率相比于传统目标识别算法得到了显著的提升。

深度神经网络是基于人工神经网络发展起来的,其属于交叉学科的融合发展,在生物学领域人们发现一种划分层次的机构,这种结构被应用于哺乳动物对外部信息的处理中,这些信息在通过视网膜和脑皮层并被处理的过程中会经过许多神经元,这些神经元分为浅层和深层神经元,其中,浅层神经元会对输入的信息进行简单的预处理,包含对目标浅层信息的提取等操作,而后传递到下一级深层神经元,再对高级特征进行提取。受到生物信息处理过程的启发,神经网络算法由此而生,因为结构和特征以及工作原理与生物神经元非常相似,因此被命名人工神经网络,其输出的准确与否取决于隐层数和神经元数量的增多,但由此也产生了新的问题,层数的增加会增加计算机的运算量,同时更依赖数据集的训练样本数量,因此,在过去神经网络的发展一直受制于计算机运算处理能力和大数据。随着大数据时代的到来和计算机处理能力的提高,神经网络焕发了新的生机,由于具备了多个中间层,因此称之为深度神经网络。[1]深度神经网络根据其功能的不同有很多分支,包括卷积神经网络以及深度置信网络和循环神经网络等。在图像处理方面,卷积神经网络因为其优秀的目标特征提取能力,得到了广泛的应用。深度神经网络利用部分网络层进行图像信息的特征提取,在将这些特征组合在一起生成新的特征,通过非线性函数增加其非线性拟合能力,并通过海量数据集提高其泛化能力。

本文就依次展示了几个常见的深度神经网络模型,分别是LeNet-5模型、AlexNet模型以及VGG模型。

1 LeNet-5

LeNet-5卷积神经网络模型于1998年被提出[2],具备了7层的网络架构,主要包含输入层、卷积层、池化层、全连接层以及输出层。其中以像素为32×32的图片作为输入层,卷积层的卷积核则是5×5的尺寸,卷积层会利用卷积核对输入的原始图片进行卷积取样,进而得到图像的特征,作为输出,在通过采样层进行采样,获取到尺寸为14×14或5×5的图像。全连接层则将这些神经元全部连接到一起,在经过一定的处理后传递给输出层。

2 AlexNet

AlexNet于2012年被提出,它的网络层级是和LeNet-5一样的,同样为7层[3]。卷积核的数量是五个,全连接层则相对于LeNet-5做出了改进,由1个变成了2个。并通过计算机图像处理单元在网络训练过程中实施加速。AlexNet卷积神经网络引入Dropout技术[4]对网络进行降参处理,使用Dropout技术后,会在隐层中随机失活一些神经元从而达到减少训练参数的目的,针对训练样本过少的问题,通过对输入图像进行预处理,进而获得更大的训练数据集。为了防止过拟合现象的产生,网络通过引入特定算法降低图像的识别度,针对传统激活函数训练时间长的问题,则通过引入ReLU函数,抑制落在函数左半平面的神经元。

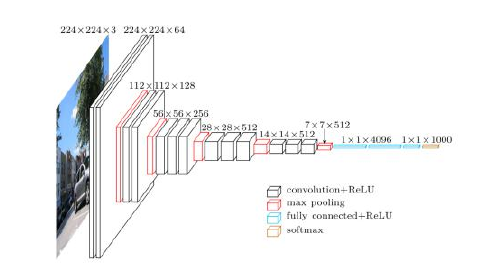

3VGG

2015年,VGG卷积神经网络的出现再一次提高了目标识别的准确率和速度,它是由Simonyan等创造的,并在AlexNet网络模型上进行了改进[5],主要是针对网络的层数和网络层神经元的数量进行了增加,并对卷积核进行了一定的降维,VGG网络在图像处理领域上出色的表现验证了网络层数和神经元个数是决定深度神经网络识别准度的一个关键指标。当然,网络层数也不是越多越好,经过实验,16到19层是最适合的网络层数。

图1 VGG16模型

4 深度神经网络未来的发展方向

(一)数据集的丰富

准确的识别目标很大程度上依赖的是数据集,数据集的质量决定了检测算法的整体性能。不同的数据集训练出来的网络模型差异是非常明显的,对于深度神经网络的训练,所需要的数据量是非常庞大的,因此在大数据时代之前一直都没有发展起来,近几年随着大数据及其处理技术的逐步完善,才使其得到了真正意义上的发展。目前主流的数据集是ImageNet以及PASCAL VOC数据集等。

(二)计算力的提升

与传统的识别算法,深度神经网络模型在训练过程中是非常需要计算机的运算处理能力的,因此它对计算机的性能非常的依赖。目前的手段主要从以下三点出发。一是对计算机升级,提升其运算和处理能力,尤其是对图像处理单元的升级。二是研究专用于深度神经网络算法的神经网络芯片。三是通过对目标检测算法进行优化,通过对函数进行简化,减少计算机的运算量,二是通过对算法对数据的拟合程度进行改进,虽然拟合程度越高,算法越好,但是在训练集上一旦过拟合,算法的迁移能力就会降低。

参考文献

[1]Srivastava N, Hinton G, Krizhevsky A, et al. Dropout: a simple way to prevent neural networks from overfitting[J]. Journal of Machine Learning Research, 2014, 15(1):1929-1958.

[2]蒋昂波,王维维ReLU激活函数优化研究[J].传感器与微系统,2018(2):21-23.

[3]He K,Zhang X ,Ren S, et al. Deep Residual Learning for Image Recognition[C]//Computer Vision and Pattern Recognition.IEEE, 2016:770-778.

[4]常亮,邓小明,周明全,等.图像理解中的卷积神经网络[J].自动化学报,2016,42(9):1300-1312.

[5]孙志军,薛磊,许阳明,等.深度学习研究综述[J].计算机应用研究,2012,29(8):2806-2810.